Следующая волна цифровой паранойи: настоящие дипфейки

В каком-то смысле дипфейки демократизируют то, что Голливуд годами делал с технологией CGI, передавая эту технологию в руки всех, кто скачивает приложение. YouTube / Two Minute Papers

Итак, мы уже предупреждали вас об опасности дипфейков. Эксперты по безопасности предостерегли, что дипфейки сыграют зловещую роль на выборах 2020 года. И мы уже видели хаос, который разразился, когда видео Нэнси Пелоси было замедлено, чтобы создать впечатление, будто она пьяна. Хотя это и не дипфейк, отснятый материал продемонстрировал, насколько быстро измененное видео может стать вирусным и заставить людей усомниться в достоверности того, что они видят.

Теперь, чтобы нас осознать, дипфейк похож на цифровой марионетка, которая использует машинное обучение и 3D-модели лица цели, что позволяет вам манипулировать человеком в видео, а также редактировать и изменять то, что он или она говорит. По мере развития технологий эти изменения все больше и больше проявляются в виде единого аудиовизуального потока без скачкообразных переходов.

СМОТРИ ТАКЖЕ: бывший инженер Google предупреждает, что «роботы-убийцы» искусственного интеллекта могут вызвать катастрофы

Какие проблемы могут возникнуть с этим?

Ну, допустим, во время сезона выборов кто-то создает дипфейк кандидата, извергающего расовые эпитеты. Видео может легко стать вирусным, прежде чем будет доказано, что оно фальшивка, и ущерб уже будет нанесен.

В мире дипфейков так много внимания уделяется хаосу, который потенциально может быть нанесен изменяя и / или манипулируя лицами политических лидеров, знаменитостей и обычных людей.

Но это только начало. Готовы к следующему уровню глубокой подделки?

На самом деле эти алгоритмы глубокого обучения могут нанести гораздо больший вред, разрушая жизни людей. Представьте себе, если хотите: синтетическая медиа-технология, способная создавать ... дипфейки всего тела.

Святые великие шары дипфейк-огня! Да, это был лишь вопрос времени.

Прежде чем я углублюсь в детали того, как это работает, давайте сделаем вдох и подумаем обо всех возможных неприятностях, которые это могло вызвать. Таким образом, вместо новостных репортажей, спекулирующих на легендарной «Пи-ленте» президента Дональда Трампа, дипфейкеры потенциально могут создать полную имитацию указанного действия и, так сказать, просочить ее в мир. (Ура.)

В те архаичные дни августа 2018 года семена полных дипфейков уже были заложены. Исследователи из Калифорнийского университета в Беркли представили доклад под названием: Everybody Dance Now. Предпосылка их исследования заключается в том, как алгоритмы глубокого обучения могут передавать движения профессиональных танцоров на тела любителей.

По словам автора:

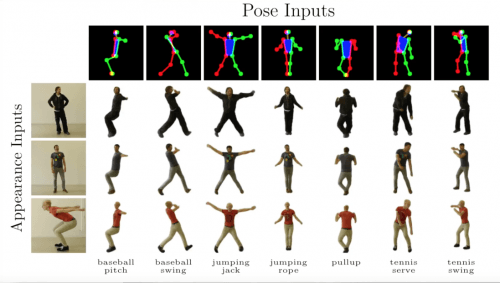

Учитывая исходное видео человека, танцующего, мы можем перенести это выступление на новую (любительскую) цель уже через несколько минут после того, как целевой объект выполнит стандартные движения. Мы подходим к этой проблеме как к трансляции видео в видео, используя позу в качестве промежуточного представления. Чтобы передать движение, мы извлекаем позы из исходного объекта и применяем выученное сопоставление позы и внешнего вида для создания целевого объекта.

Хотя технология все еще немного примитивна, это довольно круто прочее, поскольку он может управлять движениями всего тела от исходного объекта к целевому объекту

Итак, это технология, которая отлично подходит для того, чтобы сделать плосконогих людей-любителей, которые не умеют танцевать, похожими на профессиональных копытень. Используя подходящее видео, вы можете заставить любого обычного человека выглядеть танцующим, как Барышников.

Но Калифорнийский университет в Беркли не одинок в своем исследовании манипуляции с телом. В апреле Data Grid, японская компания, занимающаяся искусственным интеллектом, создала искусственный интеллект (AI), который может автоматически создавать виртуальные модели для рекламы и моды. Технология искусственного интеллекта компании может генерировать модели всего тела людей, которых в действительности не существует, с помощью генеративных состязательных сетей (GAN).

Технология Data Grid отлично подходит для сокращения затрат в индустрии моды и одежды, но не необходимость нанимать эти надоедливые, дорогие модели и просто создавать реалистично выглядящую модель ИИ.

В некотором смысле дипфейки демократизируют то, что Голливуд годами делал с технологией CGI, передавая эту технологию в руки любого кто скачивает приложение.

Но это еще не все. Доктор Бьорн Оммер, профессор компьютерного зрения в Коллаборации обработки изображений (HCI) Гейдельбергского университета и Междисциплинарном центре научных вычислений (IWR), является одним из авторов исследовательской статьи: «На пути к изучению реалистичного изображения человеческого поведения».

Команда Оммера также занимается разработкой синтетических материалов для всего тела. Их цель - научить ИИ изучать движения человека через видео. Алгоритм превратит человека в определенную позу; от целевого видео к целевой теме. Один из представленных сценариев может заставить вас выглядеть так, как будто вы делаете 100 подтягиваний.

Довольно удивительная технология для тех, кто хочет выглядеть как чемпион по подтягиванию; но в мире политики технология может быть проблематичной другой историей, особенно когда развитие дипфейков с полным телом становится невозможно отличить от реальных вещей.

Так что это хорошо, что никто никогда не будет , когда-либо использовали эту технологию во злонамеренных целях. Верно?

комментариев